成立两年半的MiniMax,第一次面对大家,讲了讲它的初心和愿景。MiniMax大模型已有日均 30 亿次 AI 交互量,每日处理3万亿token。基于MOE(混合专家架构)+ Linear Attention(线性注意力)的新一代模型技术的应用与多项最新研发成果,也在伙伴日中与大家见面。

MiniMax用技术突破回答“每日与世界的30亿次交互”,以Intelligence with Everyone为愿景,也相信这是实现AGI最高效、且唯一的途径。本次伙伴日上,MiniMax发布了视频模型abab-video-1、音乐模型abab-music-1,更新语音模型abab-speech-1。此外,MiniMax将在未来数周内发布使用 MoE + Linear Attention 技术的多模态模型abab 7。

MiniMax创始人闫俊杰带来了一场主题分享,更多精彩亮点,文中为您呈现。

01

最新技术发布

· 视频模型abab-video-1:

abab-video-1具有压缩率高、文本响应好、风格多样,支持原生高分辨率、高帧率视频等特点,媲美电影质感。用户可登录海螺AI网页版,尝鲜体验生成自己的独家创意视频。

· 音乐模型abab-music-1:

abab-music-1支持多功能端到端音乐生成,可用于合成多种音乐形式,包括纯音乐、清唱作品,且满足伴奏、人声同时生成,大大简化音乐录制与创作过程。

· 语音模型abab-speech-1:

更新后的abab-speech-1支持包括粤语、韩语、⻄班牙语、日语等多语种,生成语句超拟人,情绪变化细腻自然。

· 新一代 MOE+ Linear Attention 模型技术发布:

支持高效训练海量数据,实用性和响应速度极大提升,大幅减少了大模型的训练和推理成本。相比于通用Transformer架构,在128K的序列长度下,新架构成本减少90%以上,且序列长度越长,优势越明显。

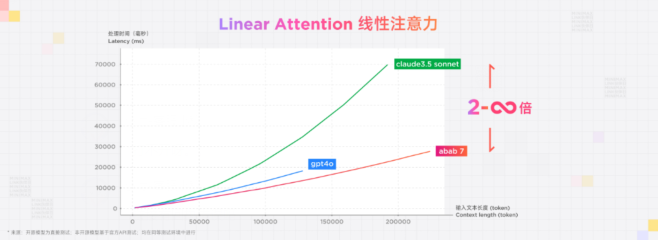

使用 MoE+Linear Attention 技术的多模态模型abab 7将在数周内上线。在与GPT-4o同一代模型能力对比上,新一代abab模型处理10万token时效率翻倍提升,并且随着长度越长,提升越明显。

02

MiniMax是国内日处理量、交互时长最高的大模型公司

· MiniMax大模型每日与全球用户进行30亿次交互,包含

· 日均处理超3万亿文本token,相当于一天内体验完3000段人生;

· 日均生成2000万张图片,相当于400座故宫的画作收藏;

· 日均合成7万小时语音:相当于一天读完7000本书。

03

Intelligence with Everyone

很多时候,不是我们的技术在帮助用户,更多的是用户在帮助我们。我们的用户多元、充满创意,有活力。正是有了他们的参与和反馈,才会有更好的智能。技术的创新与突破,源于人们对技术的信仰和坚守。MiniMax将持续通过技术突破推动AI加速发展,拓展人类智慧的边界。目前,MiniMax视频模型与音乐模型均已在开放平台和海螺AI网页版上线。未来希望与更多生态伙伴携手,探索音乐模型和视频模型的落地场景,让科技赋能创作和想象力。我们与各位携手努力,真正实现Intelligence with Everyone。

附 IO演讲全文:

大家好,我是MiniMax的创始人IO,欢迎来到我们的第一次伙伴日活动。

首先给大家介绍一下MiniMax创立之前的故事。在创业之前,我做了超过十年人工智能的研发。当时的人工智能是什么呢?最有代表性的应用就是人脸识别和AlphaGo。过去,大部分场景都是需要定制模型,但是又没法做到每个场景都定制,因此人工智能对很多人而言,只是个高大上的概念。这让作为从业者的我越来越困惑:我们花这么大力气研究人工智能,到底为了什么?

2021年的春节,我回了趟老家去看望外公。他们那代人经历的一生,是我小时候最喜欢听的故事。80岁的外公想写一本回忆录,但他不会打字,也没有足够的精力去查询资料。理论上AI很合适来完成这件事情,但是很遗憾,那个时候的AI做不到。

这件事让我意识到,AI发展的终极目标,是变得更加通用,能帮助到每个人。三个词总结,也就是Intelligence with Everyone。当我想通了这一点,一切都开始变得清晰。这让我找回了对AI研究的初心和热爱,以及一种强烈的使命感。但问题接踵而来:该如何开始?

为了追求这个目标,在2021年底,我们成立了MiniMax。在一个不到100平米的房间里写下来初心和路径,其中的三个判断,直至今日我们都依然坚定选择。

第一,我们认为下一代人工智能是无限接近通过图灵测试的智能体,交互自然,触手可及,无处不在;

第二,这实在太难了,现在看起来难,当时更难。想要实现这样的目标,更像造芯片一样,是一个巨大的系统工程,不能只做5%、10%这种提升,需要能带来数量级提升的技术突破。

第三,因为这件事很难,所以我们要坚定地分步走、拆解问题。我们判断应该先从容错率高的闲聊、写作切入。当技术一步一步提升,就可以做更强大的、以解决问题为导向的应用。最终给每个人带去智能的延展。

Intelligence with Everyone,和用户共创智能,不仅是目标,也是最高效,甚至是唯一的路径。很多时候不是我们的技术在帮助用户,更多的是用户在帮助我们。有了多元化用户的参与和反馈,才有更好的智能。

从2021年12月9日成立到今天,刚好996天。目前,每天MiniMax的大模型和终端用户(包括自有的产品+开放平台伙伴)进行30亿次交互。30亿次是什么概念?包含了每天处理超3万亿文本token,每天生成2000万张图和每天生成7万小时语音。

3万亿文本token又是什么概念呢?相当于一天内体验完3000段人生。

这30亿次连接背后,是来自于全球各地的用户,是陪伴我们一起成长的用户。他们来自全国各地,无论男女老幼,都有着共同特点——多元、充满创意和活力。我们努力用好的技术与他们共创惊喜时刻,这也是我们更加专注在改进技术的底层源动力。而这些用户真实的故事,汇聚成了MiniMax模型每日超3亿分钟的交互时长。

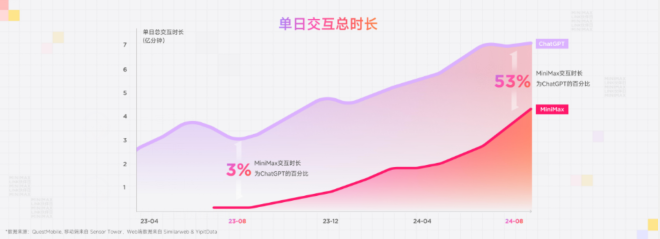

交互时长也是处理量的最佳近似指标,因为在很多第三方的数据网站上,像QuestMobile、Sensor Tower都可以查到相关的数据。一年前的今天,当时我们每天的交互时长大概只是ChatGPT的3%,直到今天这个时长超过50%。这也是目前所有中国公司里面最大的交互时长。

多个数据表明,我们可能是国内大模型日处理量最大的公司。但即使取得了一定的进展,我们所连接的用户还没有达到全球人口的1%,距离我们Intelligence with Everyone的目标还有很长的路要走。

如何从今天的1%增长到100%,最重要的是提高AI产品在用户中的渗透率和使用深度。基于过去两年多的多次的复盘和总结,我们认为提升这两点只能通过一件事情来完成:“科学技术是第一生产力”。放在大模型这样一个小的领域来看——每当我们的模型有重大提升,处理速度有显著提升的时候,就可以看到用户使用的场景和用户使用的深度显著地变高。反过来,这里还有一个曾经发生的真实案例:一个bug导致对话重复错误率变高,当天对话量掉了40%。这也解释了我们坚持技术创新的最底层原因。

今天的AI应用,要取得渗透率,和使用深度上质的提高,还有很多技术难关需要攻克。我们认为最重要的三个优化方向是:

1. 如何让模型的错误率持续降低:目前的模型还是有相对较高的错误率,有时惊艳,有时不靠谱。这也是制约模型处理复杂任务的原因,因为复杂的任务往往需要多个步骤,而较高的错误率导致失败率的指数增加。降低模型的错误率,是一个能够让模型处理复杂任务的一个最根本的前提,这个也是能够来增加用户使用深度的核心手段。

2. 无限长的输入和输出:为什么这件事情重要?很简单的原因,就是人具备这个能力,可以处理无限长度的输入跟输出。传统大模型计算需求随着输入输出处理量平方上升,很快就会达到算力无法负担的上限,需要底层创新解决。

3. 多模态:从生活中不难发现,文字交互只是很小的一部分,更多的是语音和视频交互。多模态的内容,比如声音,图文和视频,已经成为信息传递的主流。为了能够提高渗透率,多模态就是必经之路。

那么,如何攻克这些技术难关?在大模型领域,我们认为在同样的能力范围内,“快就是好”。我们都知道大语言模型里面有Scaling law,意思是说在算法一样的情况下,拥有更多的训练数据量和参数量就意味着更好的效果。因此,在两个性能类似的模型中,训练和推理更快的那个,可以更有效地利用算力资源迭代更多的数据,从而能够有一个更好的模型能力。

所以我们认为,快就是好,这是一个朴素但很容易被人忽视的哲学。“快”是MiniMax底层大模型的核心技术研发目标。围绕这点,我们做了很多技术革新,这边分享两个具体的例子。

第一,MOE。在MOE架构还没有被行业认可时,我们就做出了一个决定,在国内率先完成核心MoE算法技术路线的突破。我们对比了Dense模型和非原生的MOE、原生的MOE。在上一代的模型6.5s里,我们用MOE的模型比Dense的模型快3-5倍。这个也是为什么abab 6.5s模型,能够每天处理几十亿次非常核心原因。我们的abab 6.5s足够快,所以得到了广泛的部署。

在解决MOE问题的时候,我们遇到过很多技术挑战,但是我们花了很多精力最终解决问题之后,让我们坚定了自研的信心和直面复杂技术挑战的勇气,这种勇气使得我们在过去几个月又解决了一个更难的技术挑战。

第二,Linear Attention。这不仅能带来一个级别的提升,也是解决无限长度输入和无限长度输出的关键一步。简单来说,Linear Attention就是通过把Transformer 中的计算左乘找到一个右乘的近似,把传统模型架构中输入长度和计算复杂度之间平方增长的关系,变成线性的关系。

尽管在2019年就有人曾提出这种想法,但从来没有人在大规模的模型上做work。我们团队找到了一种新的归一化方式来代替Softmax,以及一种位置编码来提供计算的非线性。除此之外,我们找到了一种高效的方式,使大规模训练Linear Attention成为可能。

今年4月,我们开始作为第一个钻研Linear Attention的中国AI公司,成功研发出了新一代的基于MOE+ Linear Attention 的模型,真正可以比肩GPT-4o的水平。以国际上领先的三个模型为例,GPT-4o、Claude3.5 sonnet、abab 7,可以看到在输入的长度变长的时候,速度的提升相比非Linear Attention的模型有非常显著的变化。在处理10万token时,新模型的处理效率可达2-3倍,并且随着长度越长,模型效率提升越明显。理论上,模型可以处理的token接近无限长。

在做Linear Attention的过程中,我们非常惊喜地发现,其实GPT-4o也是这么做的。这件事还是给了我们很大的信心,我们发现在探索前沿技术的道路上,跟国际上最好的公司殊途同归的。MiniMax团队具备了越来越强的技术创新能力,我们需要继续坚持,不断找到加速技术进步的创新,才真的有机会去成为全球顶级的技术公司。

我们意识到,即使我们做了MOE,做了Linear Attention,有了好几倍的提升以后,还仍有很多其他的技术创新需要我们去做。有多个能带来几倍提升的技术后,再去做乘法,才有可能让AGI成为现实。abab 7模型的核心技术正是基于MoE+Linear Attention。除此之外,我们在abab 7上还构建了多模态理解能力。此外,我们把类似的创新技术应用在文本等多个模型上,包括声音和视频。

今天,我们MiniMax的语音模型增加了在国际上领先,且非常实用的功能:

1. 多个语种:支持包括日语、韩语、西班牙语、法语、粤语等10多个语种。MiniMax也成为全球第一个拥有地道粤语语音模型能力的公司;

2. 情绪表达:生成的语句超拟人,拥有细腻的情绪变化;

3. 音乐:MiniMax的第一款音乐模型面世了。这个模型有极高的艺术性和可塑性,相信会给我们的创造者和伙伴们带去非常多的新玩法和惊喜。

我们的语音模型是从星野、海螺和Talkie等产品中打磨出来的。我们坚持在自己的产品和API中使用相同的模型。

MiniMax推出了我们的第一个视频模型,也有可能是目前最好的视频生成模型。相比市面上的视频模型,我们的模型独特性有:

1. 文本响应好:得益于MiniMax在文本上不断积累,指令遵循好;

2. 压缩率高 :得益于我们在网络架构上的经验积累,对高动态、变化多的信息有较好的表现力,其中Linear Attention所带来的高推理效率功不可没。

3. 风格多样:我们在全球拥有多元化的用户分布。无论是3D电影大片场景,还是2D动画均可驾驭;无论是中式风格还是科幻、美漫,都难不倒它。

当我们把更新后更强大的MiniMax模型能力综合起来,会发生什么呢?我们尝试用多种模型生成一段短片《魔法硬币》,并且没有任何人工修改。后续,我们会将视频背后应用的prompt公布,为大家提供一个“如何只用模型来生成高质量的视频内容”的参考。未来,我们会把所有新推出的模型和能力,都同步在MiniMax开放平台和星野、海螺AI中体验。

我这边有一枚魔法硬币。我们很希望,我们的AI能够像这枚魔法硬币一样,能够帮助很多人创造无穷的想象力,能够把它带给每个人。

在模型与产品的更新方面,声音模型、音乐模型、视频模型目前已经完全公布。此外,新一版的能够从速度和效果上都能够对标GPT-4o的模型abab 7,会在未来几周内发布。

所有的模型,包括最好的音乐模型、声音模型,最好的视频模型,以及我们认为有可能会变成最好的文本模型,都可以在开放平台里体验。我们的开放平台目前为止已经有了超过3万名客户和开发者,并且仍在持续快速增长。同时,这些模型也可以第一时间在海螺AI中体验,海螺AI也是我们在个人助手领域一个主力的产品。当把复杂的模型一起来用时,到底能组合出来什么样复杂的、更高级的玩法,我们会放在内容社区产品星野APP里面。

作为理想主义且脚踏实地的MiniMax人,我们仍然在努力前行;两年半后的今天,很幸运我们的同行者中多了那么多在座的各位,以及我们全球各地日益增长的用户们。感谢各位的持续关注与支持。希望与各位携手努力,和MiniMax一起,把人类的智能边界再向外推动一点,真正实现Intelligence with Everyone。

微信公众号搜索【MiniMax稀宇科技】,了解AI圈最新技术进展 ,和MiniMax一起共创智能。

免责声明:市场有风险,选择需谨慎!此文仅供参考,不作买卖依据。

关键词:

营业执照公示信息

营业执照公示信息